(MobileWorld.vn) – Ông Koray Kavukcuoglu,, CTO Google Deepmind, đại diện đội ngũ Gemini vừa có những thông tin chia sẻ về Gemini 2.0 với những tính năng AI nổi bật, mời các bạn xem qua. Và dưới đây là bài viết của ông Koray Kavukcuoglu:

Tháng trước, chúng tôi đã khởi đầu kỷ nguyên tác nhân bằng cách phát hành phiên bản thử nghiệm của Gemini 2.0 Flash — mô hình làm việc hiệu quả cao dành cho các nhà phát triển với độ trễ thấp và hiệu suất nâng cao. Đầu năm nay, chúng tôi đã cập nhật 2.0 Flash Thinking Experimental trong Google AI Studio, nhằm cải thiện hiệu suất bằng cách kết hợp tốc độ của Flash với khả năng suy luận các vấn đề phức tạp.

Tuần trước, chúng tôi đã giới thiệu bản cập nhật 2.0 Flash cho tất cả người dùng ứng dụng Gemini trên máy tính và thiết bị di động, giúp mọi người khám phá những cách thức mới trong việc sáng tạo, tương tác và cộng tác với Gemini.

Hôm nay, chúng tôi chính thức phát hành phiên bản cập nhật Gemini 2.0 Flash, hiện sẵn có tại Gemini API trong Google AI Studio và Vertex AI. Các nhà phát triển giờ đây đã có thể tiến hành xây dựng các ứng dụng hoàn chỉnh với 2.0 Flash.

Chúng tôi cũng ra mắt phiên bản thử nghiệm của Gemini 2.0 Pro, mô hình tốt nhất từ trước đến nay về hiệu suất viết code và các câu lệnh phức tạp. Gemini 2.0 Pro sẽ có sẵn trong Google AI Studio, Vertex AI, và trong ứng dụng Gemini dành cho người dùng Gemini Advanced.

Gemini 2.0 Flash-Lite, mô hình mới và tiết kiệm chi phí nhất cũng được ra mắt trong bản thử nghiệm trên Google AI Studio và Vertex AI.

Cuối cùng, phiên bản 2.0 Flash Thinking Experimental đã được cung cấp cho người sử dụng ứng dụng Gemini trong menu lựa chọn mô hình trên máy tính và thiết bị di động.

Tất cả các mô hình này sẽ hỗ trợ đầu vào đa phương thức với đầu ra là văn bản. Các phương thức bổ sung khác sẽ được ra mắt rộng rãi trong vài tháng tới. Thông tin chi tiết hơn, bao gồm các thông tin về chi phí, sẽ được đăng tải trong blog Google for Developers. Trong tương lai, chúng tôi sẽ nỗ lực cập nhật và cải thiện khả năng cho các mô hình trong gia đình Gemini 2.0.

2.0 Flash: Cập nhật mới cho khả năng sử dụng rộng

Được giới thiệu lần đầu tại sự kiện I/O 2024, dòng Flash nổi tiếng với các nhà phát triển như một mô hình có công suất mạnh mẽ, tối ưu cho các tác vụ khối lượng lớn, tần suất cao ở quy mô lớn và có khả năng lý luận đa phương thức trên một lượng lớn thông tin với cửa sổ ngữ cảnh một triệu token. Chúng tôi rất hào hứng khi mô hình này nhận được sự đón nhận từ cộng đồng nhà phát triển.

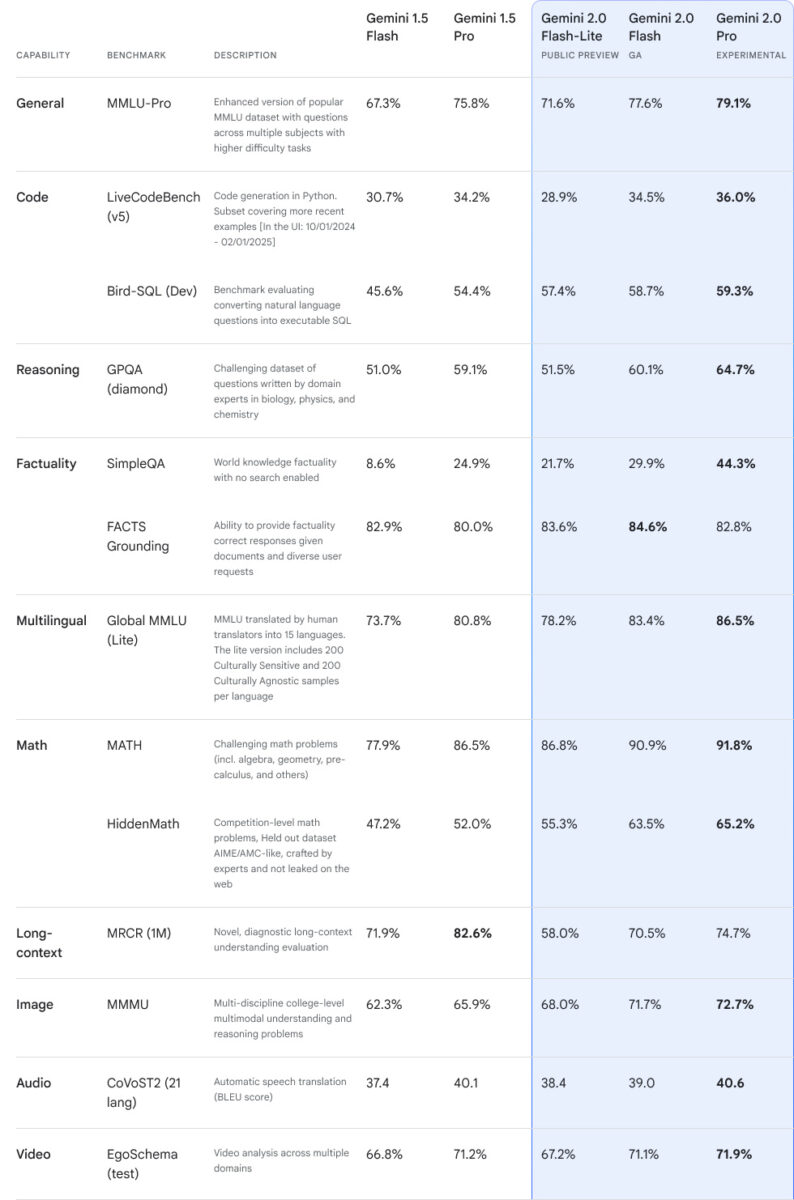

Phiên bản Flash 2.0 hiện được phổ biến đến nhiều người dùng hơn trên các sản phẩm AI của chúng tôi, cùng với hiệu suất được cải thiện đáng kể ở nhiều tiêu chí đánh giá then chốt. Các tính năng tạo ảnh và chuyển văn bản thành giọng nói cũng sẽ sớm được tích hợp.

Thử ngay Gemini 2.0 Flash trong ứng dụng Gemini hoặc Gemini API trên Google AI Studio và Vertex AI. Thông tin chi phí có trên blog Google for Developers.

2.0 Pro Experimental: Mô hình tốt nhất của chúng tôi cho hiệu suất lập trình và các câu lệnh phức tạp

Kể từ khi bắt đầu chia sẻ các phiên bản thử nghiệm đầu tiên của Gemini 2.0, ví dụ như Gemini-Exp-1206, chúng tôi đã nhận được rất nhiều phản hồi tích cực từ các nhà phát triển về những ưu điểm và ứng dụng hiệu quả nhất của nó, đặc biệt là lập trình.

Hôm nay, chúng tôi chính thức ra mắt phiên bản thử nghiệm của Gemini 2.0 Pro, được cải tiến dựa trên những phản hồi mà chúng tôi đã nhận được. Đây là mô hình có hiệu suất lập trình vượt trội và khả năng xử lý các câu lệnh phức tạp, đồng thời hiểu và lập luận kiến thức bách khoa tốt hơn các mô hình mà chúng tôi từng ra mắt. Với cửa sổ ngữ cảnh lớn nhất từ trước đến nay, lên đến 2 triệu token, nó có thể phân tích và hiểu một lượng thông tin khổng lồ, và còn có thể sử dụng các công cụ như Google Tìm kiếm và thực thi đoạn mã (code).

Gemini 2.0 Pro hiện đã có sẵn phiên bản thử nghiệm cho các nhà phát triển trên Google AI Studio và Vertex AI, cũng như cho người dùng Gemini Advanced trong menu lựa chọn mô hình trên máy tính và thiết bị di động.

2.0 Flash-Lite: Mô hình tiết kiệm chi phí nhất của chúng tôi từ trước đến nay

Chúng tôi đã nhận được nhiều phản hồi tích cực về chi phí cùng tốc độ của 1.5 Flash. Với mong muốn tiếp tục cải thiện chất lượng, đồng thời duy trì chi phí và tốc độ, chúng tôi chính thức giới thiệu 2.0 Flash-Lite – mô hình mới có chất lượng tốt hơn 1.5 Flash, với tốc độ và chi phí được giữ nguyên. Mô hình này cũng vượt trội hơn 1.5 Flash trên đa số các tiêu chí đánh giá.

Tương tự 2.0 Flash, 2.0 Flash-Lite có cửa sổ ngữ cảnh chứa 1 triệu token và dữ liệu đầu vào đa phương thức. Ví dụ, mô hình này có thể tạo chú thích phù hợp trong một dòng cho khoảng 40.000 hình ảnh riêng biệt, với chi phí chưa đến một Đô-la trong gói trả phí của Google AI Studio.

Gemini 2.0 Flash-Lite hiện đã có sẵn phiên bản thử nghiệm trên Google AI Studio và Vertex AI.